Dr.-Ing. Michael Suppa ist Mitgründer und Geschäftsführer der Roboception GmbH. Er zählt zu den Pionieren KI-basierter Bildverarbeitung in der Automatisierung und beschäftigt sich insbesondere mit der Integration von Deep Learning in industrielle Prozesse.

Sehen, verstehen, handeln: Warum 3D-Wahrnehmung ein entscheidender Hebel für autonome Robotik ist

Erst hat die Robotik gelernt zu greifen. Jetzt lernt sie zu verstehen. Mit KI-basierter 3D-Wahrnehmung verschiebt sich die Grenze dessen, was automatisierbar ist: weg von starren, perfekt vorbereiteten Prozessen hin zu flexiblen, variantenreichen Anwendungen. Dr.-Ing. Michael Suppa, Mitgründer und Geschäftsführer der Roboception GmbH, gehört zu den Pionieren dieser Entwicklung. Auf dem VDI-Kongress AUTOMATION gibt er Einblicke in aktuelle Projekte, technologische Durchbrüche und die Frage, wie sich KI sinnvoll in industrielle Prozesse integrieren lässt. Im Gespräch wird schnell klar: Es geht längst nicht mehr um Visionen, sondern um konkrete Produktivitätseffekte.

Herr Dr. Suppa, Ihr Vortrag wird mit dem Titel „3D-Wahrnehmung als Enabler für flexible und autonome Automatisierung“ angekündigt. Ist allen potenziellen Anwendern bereits klar, welche Möglichkeiten sich in Zukunft eröffnen?

Dr. Michael Suppa: Sicherlich noch nicht in der Tiefe. Viele wissen, dass KI in der Bildverarbeitung hilft. Doch wie stark sich dadurch die Art verändert, wie Automatisierung umgesetzt wird, wird oft noch unterschätzt. Der zentrale Unterschied ist: Wir kommen weg vom klassischen Parameter-Tuning. Früher wurde eine Anlage in Betrieb genommen und anschließend lange feinjustiert. Heute ist vieles davon bereits im Modell abgebildet.

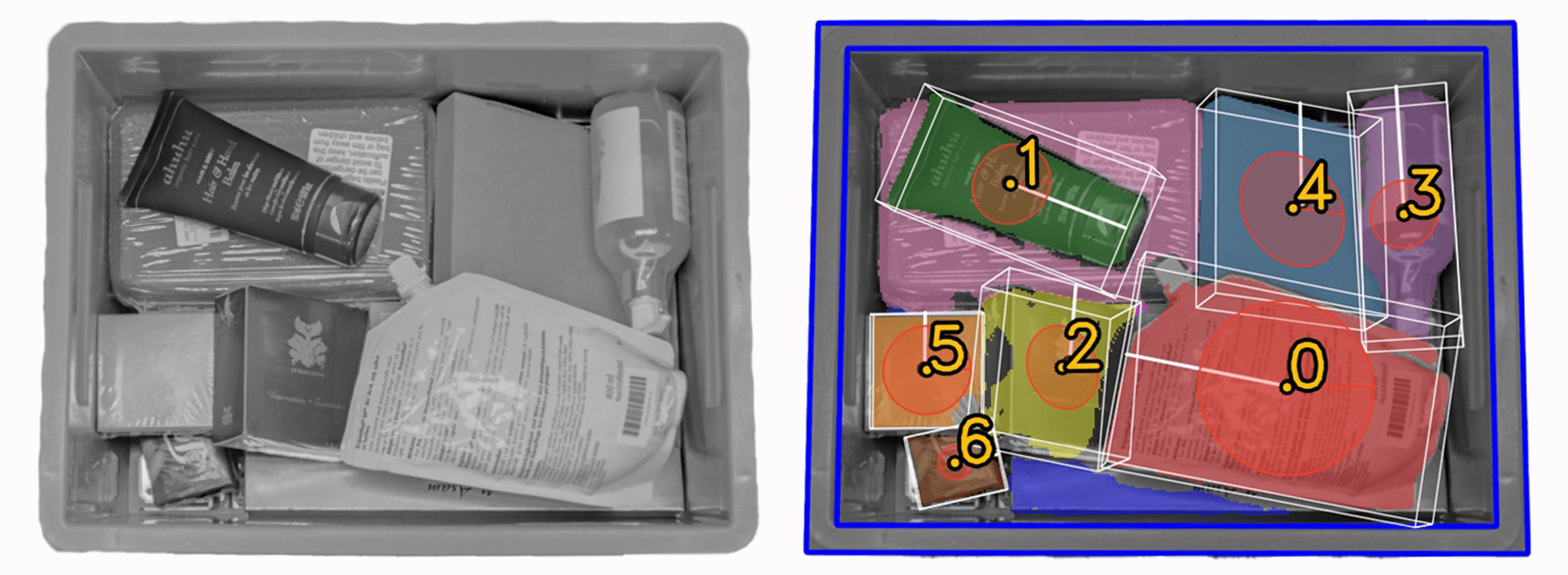

Das hat zwei unmittelbare Konsequenzen. Erstens können wir mit deutlich weniger Parametern arbeiten. Zweitens werden Systeme robuster gegenüber Varianzen. Statt ein einzelnes, exakt spezifiziertes Objekt zu erkennen, arbeiten wir mit Kategorien. Der Anwender sagt nicht mehr: „Das ist genau dieses Bauteil“, sondern: „Ich habe Bleche“ oder „Ich habe Tüten“. Das System versteht diese Kategorie und erkennt die Objekte entsprechend. Für den Anwender ist das ein enormer Unterschied. Er kann in seiner eigenen Sprache bleiben und muss kein Spezialwissen über Bildverarbeitung mitbringen.

Das klingt nach einem Paradigmenwechsel, weg von der exakten Spezifikation hin zu abstrahierten Kategorien. Wo liegen dabei die technischen Herausforderungen?

Dr. Michael Suppa: Die Herausforderung verbirgt sich im Spannungsfeld zwischen Generalisierung und Präzision. Ein System soll möglichst viele Varianten abdecken, das bedeutet Generalisierung. Gleichzeitig braucht die Robotik eine sehr genaue Lageschätzung, um Objekte sicher greifen zu können. Diese beiden Anforderungen stehen sich zunächst entgegen. Je generischer ein Modell ist, desto schwieriger wird es, exakte Positionen zu bestimmen. Die eigentliche Kunst besteht darin, beides zusammenzubringen.

Der Schlüssel dazu liegt im Training. Wir arbeiten stark mit synthetischen Daten, häufig auf Basis von CAD-Modellen. Damit können wir sehr gezielt Trainingsdaten erzeugen und die Modelle so auslegen, dass sie sowohl robust als auch präzise sind. Diese gezielte Auswahl und Aufbereitung von Daten ist heute das, was früher die Parametrierung war.

Welche Rolle spielt dabei Deep Learning in der industriellen Anwendung?

Dr. Michael Suppa: Deep Learning ist der Motor hinter dieser Entwicklung. Es ermöglicht, mit sehr vielen impliziten Parametern zu arbeiten, ohne dass diese explizit eingestellt werden müssen. In der Bildverarbeitung ist das besonders naheliegend, weil die Datenstruktur, also vorhandene Bilder, hervorragend zu neuronalen Netzen passt. Ein großer Vorteil zeigt sich bei schwierigen Oberflächen wie transparenten, spiegelnden oder stark variierenden Objekten. Klassische Verfahren stoßen hier schnell an Grenzen oder erfordern enormen Aufwand beim Tuning. KI-basierte Ansätze sind in dieser Hinsicht deutlich robuster.

Auch in der Qualitätsprüfung sehen wir enorme Fortschritte. Aufgaben wie eine Defekterkennung, die früher extrem aufwendig zu parametrisieren waren, lassen sich mit KI deutlich effizienter lösen. Und man darf nicht vergessen: Der Mensch ist bei monotonen Prüfaufgaben gar nicht so gut, wie man denkt. Die Aufmerksamkeit lässt schnell nach. Hier kann Automatisierung echte Qualitätsgewinne bringen.

Sie haben das Thema Effizienz angesprochen. Wie konkret lässt sich der Nutzen in Projekten beziffern?

Dr. Michael Suppa: In realen Anwendungen sehen wir Effizienzsteigerungen von 30 bis 40 Prozent. Ein Teil davon entsteht durch die bessere Performance der Bildverarbeitung selbst, ein anderer durch verkürzte Integrationszeiten. Der Integrationsaufwand verschiebt sich dabei spürbar. Früher lag viel Arbeit am Ende des Projekts, konkret beim Einrichten und Nachjustieren der Anlage. Heute investieren wir mehr in die Vorbereitung, also in das Training der Modelle. Dadurch läuft die Inbetriebnahme deutlich schneller und stabiler.

Roboception ist ursprünglich stark aus der Hardware gekommen. Verschiebt sich die Wertschöpfung zunehmend in Richtung Software?

Dr. Michael Suppa: Ja, ganz eindeutig. Wir haben als Sensorhersteller begonnen und unsere Systeme Schritt für Schritt „intelligenter“ gemacht. Heute liegt der Schwerpunkt auf der Software. Die Lösungen sind bewusst hardwareoffen gestaltet. Wir benötigen ein RGB-Bild und ein Tiefenbild – wie diese Daten erzeugt werden, ist zweitrangig. Das können unsere eigenen Stereo-Kameras sein, aber auch Systeme von Drittanbietern, etwa auf Basis von strukturiertem Licht oder Time-of-Flight.

Ein wichtiger Schritt ist auch die Art der Bereitstellung. Wir liefern unsere Software inzwischen als Container aus. Das ermöglicht es, sie flexibel in unterschiedliche IT-Umgebungen zu integrieren, etwa in Edge-Plattformen. Gleichzeitig adressieren wir damit Anforderungen an die IT-Sicherheit, die durch neue regulatorische Vorgaben deutlich an Bedeutung gewinnen.

Damit sprechen Sie bereits das Thema Ökosysteme an. Welche Rolle spielen föderierte Ansätze in der Zukunft der Automatisierung?

Dr. Michael Suppa: Föderierte Konzepte werden in Zukunft nochmals stark an Stellenwert gewinnen. Der Mehrwert entsteht zunehmend im Zusammenspiel verschiedener Akteure. Gleichzeitig ist es entscheidend, dass Datenhoheit erhalten bleibt. Föderierte Ökosysteme ermöglichen genau das: Daten bleiben beim jeweiligen Eigentümer, werden aber über definierte Schnittstellen zugänglich gemacht. Das ist ein anderer Ansatz als bei zentralisierten Plattformen.

Spannend wird es bei den Geschäftsmodellen. Wir sehen mehrere Ansätze. Einer ist die zeitlich gestaffelte Zugriffskontrolle entlang der Automatisierungskette. Dabei haben Integrator, Endkunde, Instandhalter jeweils unterschiedliche Rollen und benötigen zu unterschiedlichen Zeitpunkten Zugriff auf Systeme.

Ein zweiter Punkt ist das vereinfachte Onboarding. Gerade kleinere Unternehmen könnten deutlich leichter in Wertschöpfungsketten eingebunden werden, wenn die Eintrittshürden sinken.

Und drittens wird das Teilen von Daten wirtschaftlich relevant. Wer Daten zur Verbesserung von Modellen bereitstellt, kann davon profitieren, etwa durch günstigere Konditionen. Solche Modelle lassen sich aber nur sinnvoll umsetzen, wenn die technische Infrastruktur vorhanden ist.

Können Sie konkrete Praxisbeispiele nennen, die Sie auf dem Kongress vorstellen werden?

Dr. Michael Suppa: Sowohl aus der Produktion als auch aus der Intralogistik werden Praxisbeispiele enthalten sein. In der Logistik geht es zum Beispiel um das Handling von Post- und Paketobjekten, also eine sehr hohe Varianz bei gleichzeitig hohen Durchsatzanforderungen. Ein weiteres Beispiel ist das Verpacken am Ende einer Linie, wo Produkte effizient in Transportbehälter oder Fahrzeuge geladen werden müssen. In der Produktion sehen wir klassische Anwendungen wie Kitting oder Maschinenbeladung. Auch hier spielt die Fähigkeit, mit unterschiedlichen und teilweise unbekannten Objekten umzugehen, eine zentrale Rolle. Wichtig ist dabei, die Unterschiede zwischen bekannten und unbekannten Objekten herauszuarbeiten. Je nachdem kommen unterschiedliche Trainingsstrategien zum Einsatz.

Wo steht die Technologie heute – und wohin entwickelt sie sich in den nächsten Jahren?

Dr. Michael Suppa: Über den Punkt von Pilotprojekten sind wir deutlich hinaus. Viele Ansätze, insbesondere CAD-basierte Verfahren mit synthetischen Daten, sind bereits in der Produktion angekommen. Was gerade entsteht, ist die nächste Stufe: Modelle, die stärker prozessspezifisch sind. Allgemeine KI-Modelle können Objekte erkennen, aber für die Automatisierung reicht das nicht. Entscheidend ist die präzise Lokalisierung im Kontext eines Prozesses.

Das bedeutet, dass zunehmend Modelle entwickelt werden, die gezielt auf bestimmte Anwendungen zugeschnitten sind. Gleichzeitig stellt sich die Frage, wie bestehendes Prozesswissen in diese Modelle überführt wird. In den nächsten drei bis fünf Jahren werden wir sehen, welche Ansätze sich durchsetzen. Ich erwarte, dass sich sowohl technische Standards als auch Geschäftsmodelle rund um föderierte Ökosysteme etablieren.

Schlussfrage: Welche Erkenntnis sollen Teilnehmende aus Ihrem Vortrag mitnehmen?

Dr. Michael Suppa: Bei KI-basierter Robotik geht es im Kern um das Zusammenspiel von Daten, Prozessen und Systemarchitekturen. Aus meiner Sicht ist jetzt der richtige Zeitpunkt für Unternehmen gekommen, sich intensiver mit dem Thema zu beschäftigen. Die Technologie ist da. Die Frage ist, wie man sie sinnvoll in die eigenen Prozesse integriert.

Quelle: Roboception

Über den Autor